|

|

马上注册,结交更多好友,享用更多功能,让你轻松玩转社区。

您需要 登录 才可以下载或查看,没有账号?注册

×

作者:微信文章

导语

如今,“人工智能”、“大模型”这些词每天都在轰炸我们的信息流。很多人喜欢问:“AI 和机器学习(ML)到底有什么区别?是 AI < ML,还是 AI = ML?”

答案是:都不对。它们是包含与被包含的关系。 如果你对这些层出不穷的技术名词感到一头雾水,那么这篇零基础的 AI 扫盲指南就是为你准备的。今天,我们将拨开迷雾,用最通俗的比喻、清晰的图表,带你彻底理清 AI、ML、DL 和 Gen AI 之间的嵌套关系。

1. 概念大杂烩:打破“AI = 机器学习”的迷思

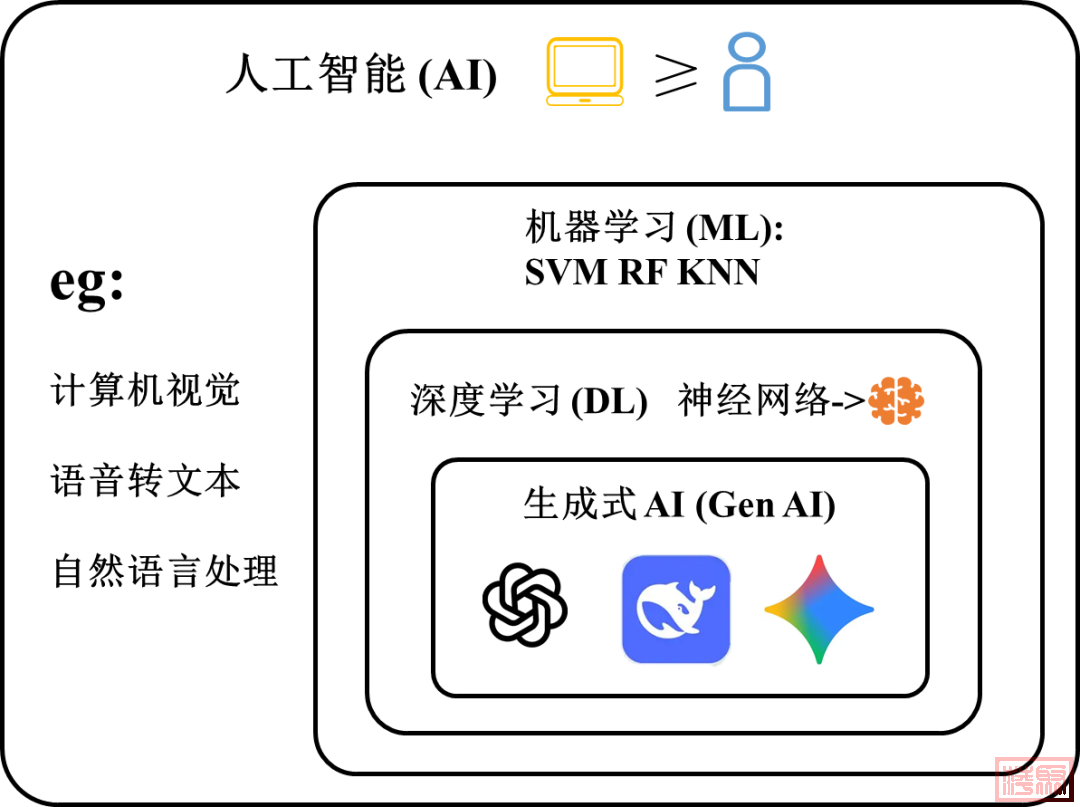

要理清这些概念,你需要在大脑里画一个巨大的文氏图,也就是我们常说的同心圆或嵌套集合。

它们并不是平行并列的技术,而是层层包含、不断向内细分的结构。外层的概念最宽泛,越往内技术越硬核,对算力和数据的要求也就越高。

下面,我们就沿着这张图,由外向内逐一拆解。

2. 人工智能 (AI):一切的起点与宏大愿景

人工智能 (Artificial Intelligence) 是最外面那把宽泛的保护伞。它的核心目标非常宏大:用计算机(机器)来模拟、匹配甚至超越人类的智能与能力。

人类有什么能力?我们能看、能听、能说、能推理,还能做出复杂的肢体运动。因此,AI 这个大伞下,包含了非常多细分的“拟人超能力”分支:

视觉与听觉 (Vision & Hearing): 让机器看懂世界。比如停车场门口的自动车牌识别,或者手机里的语音助手。说话与阅读 (NLP & Text-to-Speech): 让机器理解并表达人类的语言文字。运动控制 (Motion & Robotics): 模拟人类的小脑,控制肢体。比如让波士顿动力的机器狗完成平稳的后空翻,或者在物理引擎(如 MuJoCo)中进行复杂的动力学仿真。注意,早期的很多机器控制和物理仿真,靠的是纯粹的经典控制理论和数学建模,并不需要去“喂数据”训练,但这依然属于 AI 的重要范畴!

早期的 AI(上世纪 80、90 年代)大多是基于预设规则的“专家系统(Expert Systems)”。机器很笨,它没有真正的“智能”,只是在无情地执行程序员写好的成千上万行 if-else。现实世界太复杂了,程序员的头发掉光了也写不完所有的规则。

3. 机器学习 (ML):开发范式的彻底颠覆

既然人类程序员写不完所有规则,那就进入文氏图的下一层:**机器学习 (Machine Learning)**。

顾名思义,这次是机器“自己学习”了。这是软件工程史上的一次范式颠覆:我们不再苦哈哈地去输入逻辑规则,而是直接把海量的“数据(Data)”喂给计算机,让它通过复杂的统计学分析,自己去发现规律、总结模式并做出预测。

在工业界,机器学习主要细分为两大派系:

派系 A:监督学习 (Supervised Learning)

你给机器的数据是“带标签(答案)”的。就像老师教小学生看图识字。

应用例子: 房价预测系统。输入几千套房子的面积、地段和最终售价,它能推算出新楼盘的合理定价。

派系 B:无监督学习 (Unsupervised Learning)

你给机器的数据是一团乱麻,没有标准答案,让它自己去“找找感觉”,发现隐藏的结构。

应用例子: 网络安全中的“异常检测(Outliers Detection)”。在一堆极其规律的正常用户操作数据中,突然冒出一个行为诡异的“异类”,系统能立刻敏锐地察觉并揪出黑客。

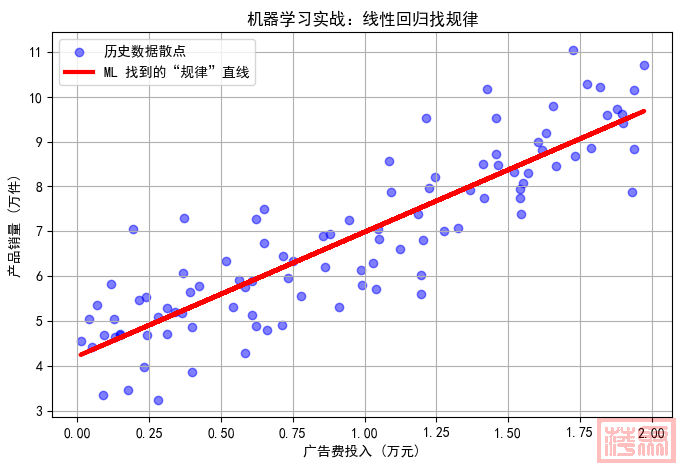

代码实战:机器学习是如何“找规律”的?

为了让你直观感受,我们用 Python 的 scikit-learn 快速跑一个最简单的线性回归模型。假设我们要预测“广告费”对“销量”的影响,机器学习的目标就是找到那条能最好拟合散点数据的直线。

import matplotlib.pyplot as plt

import numpy as np

from sklearn.linear_model import LinearRegression

# 1. 模拟带标签的数据:广告费 (X) 和 对应的销量 (y)

np.random.seed(42)

advertisement_cost = 2 * np.random.rand(100, 1)

sales_volume = 4 + 3 * advertisement_cost + np.random.randn(100, 1)

# 2. 训练机器学习模型 (监督学习)

model = LinearRegression()

model.fit(advertisement_cost, sales_volume)

# 3. 可视化结果

plt.figure(figsize=(8, 5))

plt.scatter(advertisement_cost, sales_volume, color='b', alpha=0.5, label='历史数据散点')

# 画出机器自己学会的规则(拟合直线)

plt.plot(advertisement_cost, model.predict(advertisement_cost), 'r-', linewidth=3, label='ML 找到的“规律”直线')

plt.xlabel('广告费投入 (万元)'), plt.ylabel('产品销量 (万件)')

plt.title('机器学习实战:线性回归找规律')

plt.legend(), plt.grid(True)

plt.show()

红色的直线就是机器“自己学会”的规则,它完美地穿过了蓝色的数据点。

4. 深度学习 (DL):强大却神秘的“黑盒”

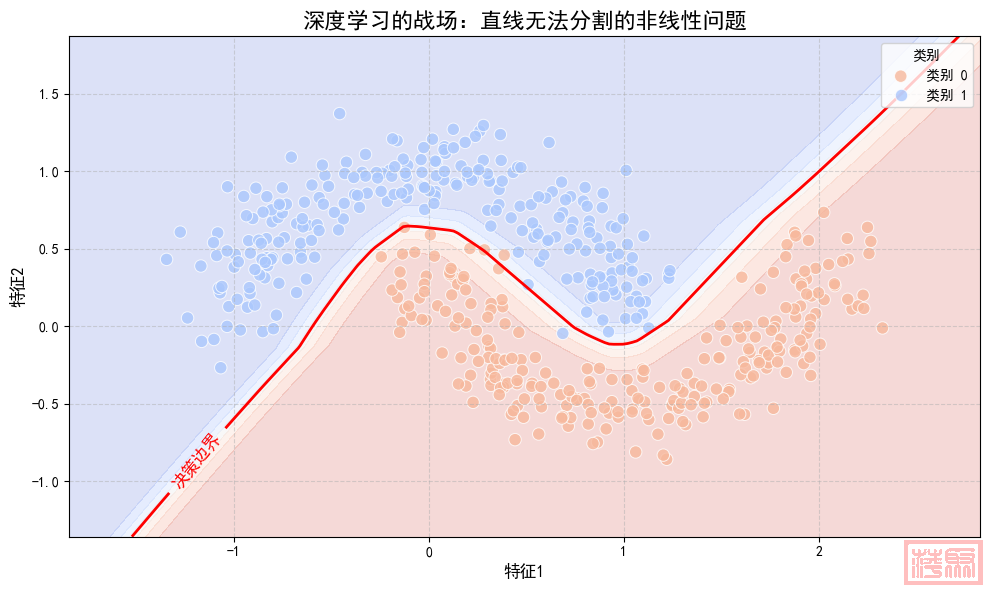

继续往同心圆的深处走,我们来到了机器学习极其硬核的分支:**深度学习 (Deep Learning)**。

为什么叫“深度”?因为科学家利用人工神经网络 (Neural Networks) 模拟人类大脑的神经元结构,且这个网络包含了多个“隐藏层(Hidden Layers)”。

它的杀手锏: 极度擅长处理“非线性”和高度复杂的抽象数据。如果数据像两个交错的月牙(见下图),普通的 ML 直线根本切不开它们,但深度学习可以通过多层网络画出复杂的非线性决策边界。它的代价(黑盒效应): 它是一个彻头彻尾的“黑盒”。比如系统诊断出一张医学 X 光片里有肿瘤,你问它“你是怎么看出来的?”,它答不上来。因为中间的决策过程是由几百万个冷冰冰的权重参数决定的,连工程师自己都无法完全用人类的逻辑去反向解释它。

import numpy as np

import matplotlib.pyplot as plt

import seaborn as sns

from sklearn.datasets import make_moons

from sklearn.neural_network import MLPClassifier

# 生成月牙形非线性数据集

X, y = make_moons(n_samples=500, noise=0.15, random_state=42)

# 神经网络拟合数据生成决策边界

mlp = MLPClassifier(hidden_layer_sizes=(100,), activation='relu', max_iter=1000, random_state=42)

mlp.fit(X, y)

# 生成网格点

x_min, x_max = X[:, 0].min() - 0.5, X[:, 0].max() + 0.5

y_min, y_max = X[:, 1].min() - 0.5, X[:, 1].max() + 0.5

xx, yy = np.meshgrid(np.linspace(x_min, x_max, 200), np.linspace(y_min, y_max, 200))

Z = mlp.predict_proba(np.c_[xx.ravel(), yy.ravel()])[:, 1].reshape(xx.shape)

plt.figure(figsize=(10, 6))

plt.contourf(xx, yy, Z, alpha=0.2, cmap='coolwarm')

contour = plt.contour(xx, yy, Z, levels=[0.5], colors='red', linewidths=2)

plt.clabel(contour, inline=True, fontsize=12, fmt='决策边界')

sns.scatterplot(x=X[:, 0], y=X[:, 1], hue=y, palette='coolwarm', s=80, edgecolor='white', alpha=0.8)

plt.title('深度学习的战场:直线无法分割的非线性问题', fontsize=16)

plt.xlabel('特征1', fontsize=12)

plt.ylabel('特征2', fontsize=12)

plt.grid(True, linestyle='--', alpha=0.5)

plt.legend(title='类别', labels=['类别 0', '类别 1'], loc='upper right')

plt.tight_layout()

plt.show()

5. 生成式 AI (Gen AI):从“做判断”到“搞创作”

最后,我们来到了同心圆的最深处,也是当下点燃科技圈的终极魔法——**生成式 AI (Generative AI)**。

以前的 ML 和 DL 大多是在做“判断题”或“选择题”(判断这是猫还是狗,预测股票是涨还是跌)。但生成式 AI 跨越了这道鸿沟,它能够凭空生成全新的内容。这得益于底层**基础模型 (Foundation Models)**(如大语言模型 LLM)的突破。

我们在用的 ChatGPT,不仅仅是在像手机输入法那样“预测下一个词”,而是在理解了庞大的上下文后,预测下一句话、下一个段落,甚至整篇文章的逻辑走向。

有人质疑:“生成式 AI 真的有创造力吗?它不过是个把网上资料嚼碎了重新拼凑的缝合怪。”

这是一个绝妙的反驳比喻:

音乐界从古至今就只有几十个基本的音符,所有的世界名曲、流行金曲,本质上都是对这些已有音符的重新排列组合。但你绝不会说新写出来的歌“不是新东西”。

生成式 AI 也是如此。它吸收了人类几千年的知识储备(音符),然后有能力为你写出一篇全新的商业报告、生成一段逼真的 Deepfake(深度伪造)音频、甚至帮你直接撸出一段 C++ 源码。它的“重新组合”,已经足以媲美人类的创造力。

总结:打破技术滤镜,AI 只是一个“超级工具箱”

今天,各种关于 AI 的新名词满天飞,很容易让人产生“技术焦虑”。但当我们把这些概念像剥洋葱一样层层拆解后,你会发现:AI 并不是什么无法理解的黑魔法,它本质上就是一个不断进化的超级工具箱。

AI (人工智能) 是这间大工坊的招牌,代表着我们想让机器更聪明的终极目标。ML (机器学习) 和 DL (深度学习) 是工坊里两台极其强悍的“数据粉碎机与规律提取机”,它们取代了老掉牙的算盘(传统 if-else 编程),极大地提升了我们处理复杂现实问题的效率。Gen AI (生成式 AI) 则是工坊里最新引进的“3D 打印机”,它不仅能分析废料,还能直接打印出精美的成品。

作为开发者和硬核玩家,我们不需要对这些名词顶礼膜拜,更没必要去争论“谁替代了谁”。搞懂它们各自的边界和底层逻辑,遇到什么痛点就去工具箱里掏出最合适的工具(比如搞预测就用 ML,搞创作就调大模型 API,搞无人机姿态仿真就老老实实写控制算法),这才是我们在 AI 时代最清醒的发力点。

掌握了这些,你就已经打败了全网 90% 只会跟风喊口号的人。这间 AI 工坊的大门已经敞开,欢迎带着你的项目,随时入场!

如果你觉得有帮助,欢迎点赞+在看👍

#AI扫盲 #人工智能 #机器学习 #深度学习 #生成式AI #监督学习 #Python可视化 #科技科普

猜你喜欢

【AI学习日记01】Anaconda入门:让Python环境管理变简单

【AI学习日记02】Jupyter Notebook:Python交互式编程神器

爆火的OpenClaw怎么玩?手把手教你把地表最强AI装进手机里!

拒绝本地显卡焦虑!VS Code + AutoDL 深度学习云端炼丹全指南

-end-

欢迎关注,一直在努力,希望和你一起进步! |

|